Pelatihan model bahasa besar (large language model/LLM) telah menjadi tantangan besar di dunia AI karena mahalnya biaya serta waktu yang dibutuhkan. Masalah utama bukan hanya soal ketersediaan GPU, tetapi juga seberapa efisien perangkat keras ini digunakan saat proses pelatihan berlangsung.

Inefisensi kecil dalam penggunaan GPU pada skala besar bisa menyebabkan pemborosan waktu serta energi yang signifikan. Penelitian terbaru menunjukkan solusi praktis yang dapat secara drastis memangkas waktu pelatihan tanpa menambah kebutuhan perangkat keras baru.

Memahami Pemborosan Waktu pada Fase Rollout

Peneliti dari MIT yang bekerja sama dengan NVidia mengidentifikasi bahwa pemborosan terbesar muncul saat tahap “rollout” dalam reinforcement learning. Pada fase ini, model menghasilkan berbagai respons kandidat untuk belajar mana perilaku yang memberikan hasil lebih baik.

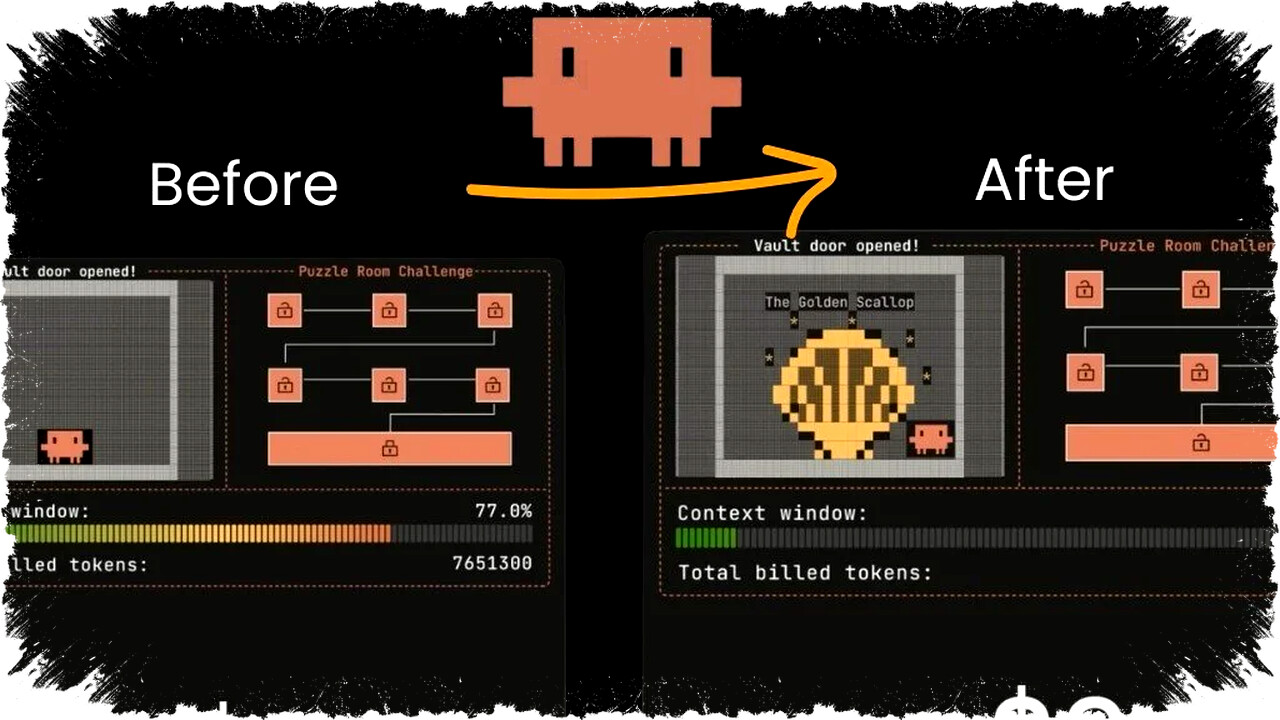

Ternyata, proses rollout ini mengambil porsi hingga 85% dari total waktu pelatihan. Ketidakseimbangan lama respons yang dihasilkan, dikenal sebagai “long-tail distribution”, menjadi pemicu utama. Mayoritas respons selesai lebih cepat, sementara sebagian kecil butuh waktu jauh lebih lama.

Akibatnya, GPU yang menyelesaikan tugas lebih awal harus menunggu GPU lain yang masih mengerjakan respons lebih panjang. Hal ini menyebabkan banyak GPU idle atau tidak dimanfaatkan secara optimal.

Solusi: Taming the Long Tail (TLT)

Untuk mengatasi masalah ini, tim MIT memperkenalkan metode bernama Taming the Long Tail (TLT). Alih-alih membiarkan GPU menganggur, TLT mengisi waktu idle dengan melatih model ‘draft’ ringan secara paralel.

Model draft ini belajar secara kontinu dari model utama selama sesi pelatihan berlangsung. Cara ini memungkinkan sumber daya yang biasanya terbuang dapat dioptimalkan untuk mempercepat keseluruhan proses pelatihan.

Dasar pendekatan ini mengadopsi teknik speculative decoding. Awalnya, speculative decoding mengandalkan model draft statis yang cepat usang. Dengan TLT, model draft dilatih dinamis sehingga selalu sejalan dengan perkembangan model utama tanpa harus mengalokasikan GPU tambahan.

Keuntungan Nyata dari TLT

Berdasarkan uji coba pada berbagai LLM berbasis penalaran dan dataset nyata, hasilnya sangat signifikan. Proses pelatihan end-to-end mampu dipercepat mulai dari 70% hingga 210% dibanding baseline kuat yang sudah ada. Ini berarti, pada banyak skenario, penggunaan TLT dapat menggandakan kecepatan pelatihan model AI.

Yang menarik, peningkatan kecepatan ini tidak mengorbankan akurasi model. Hasil pengujian menunjukkan model utama tetap konsisten dalam performanya meski pelatihan dipercepat.

Dampak Lingkungan dan Ekonomi

Penghematan waktu pelatihan berarti penurunan biaya operasional dan konsumsi energi. Jika teknik ini diterapkan secara luas dalam skala industri, potensi untuk menekan beban finansial serta dampak lingkungan dari pelatihan AI berskala besar menjadi sangat nyata.

Pendekatan seperti TLT menandai pergeseran strategi dalam perkembangan AI, dari sekadar meningkatkan jumlah perangkat keras menjadi mengoptimalkan perangkat yang sudah ada. Hal ini sejalan dengan tren riset AI global yang fokus pada efisiensi dan efektivitas.

Potensi Model Draft untuk Inferensi

Selain mempercepat pelatihan, model draft yang terus dilatih juga dapat dimanfaatkan untuk tugas inferensi tertentu. Model ini, karena sudah terlatih bersama model utama, dapat digunakan sebagai alternatif inferensi yang lebih efisien di beberapa konteks aplikasi.

Inovasi TLT menunjukkan pentingnya eksplorasi ulang pola penggunaan GPU agar setiap detik waktu komputasi memiliki nilai tambah. Data menunjukkan, optimalisasi sederhana tapi cerdas semacam ini mampu menciptakan dampak besar pada pengembangan model AI generasi berikutnya.

Jika riset semacam ini terus berlanjut dan dibuktikan tetap efisien pada skala industri lebih luas, maka dunia AI bisa memasuki era pelatihan yang tidak hanya lebih cepat, tapi juga jauh lebih ramah biaya dan lingkungan.

Source: www.gizmochina.com