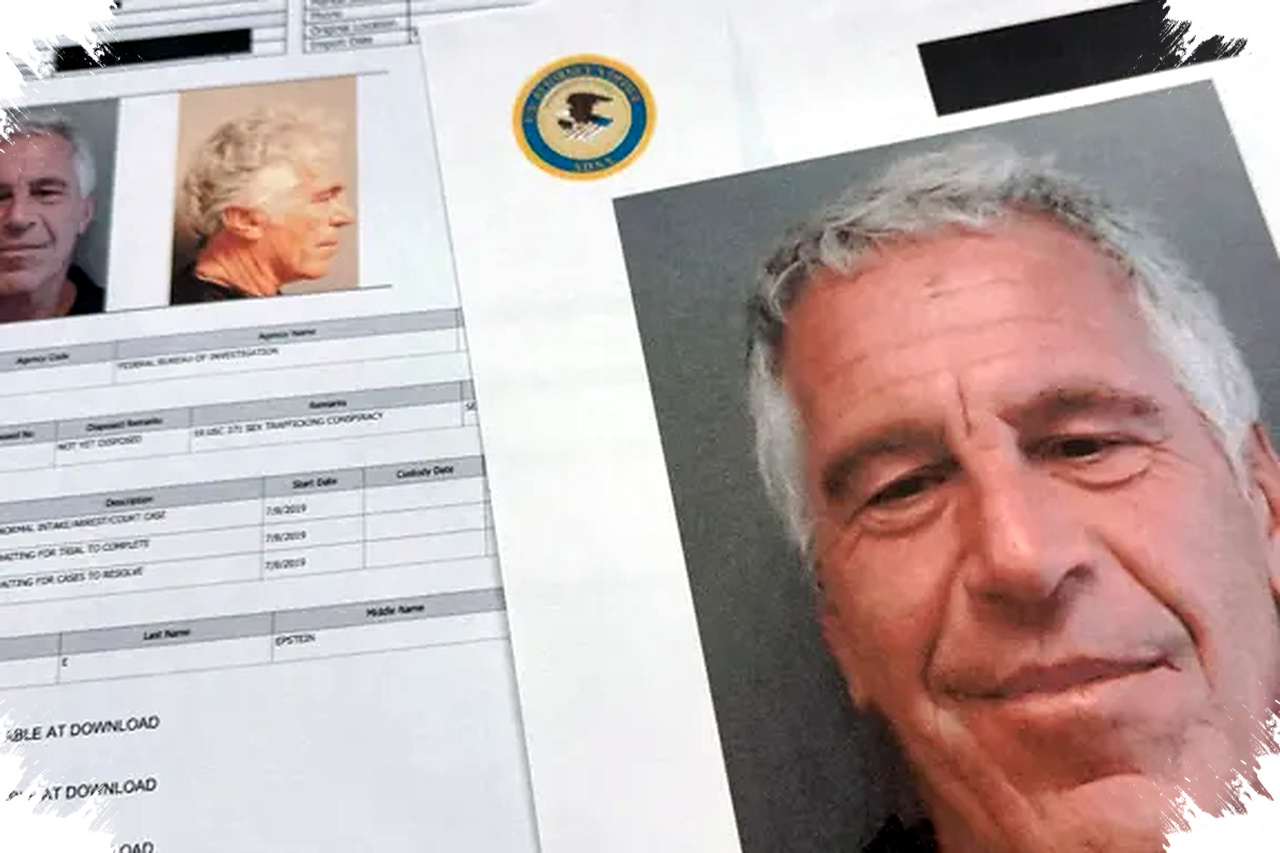

Google kini menghadapi gugatan serius di California Utara setelah teknologi AI miliknya diduga menampilkan data kontak korban Jeffrey Epstein yang seharusnya tidak muncul ke publik. Kasus ini langsung memicu perhatian besar karena menyentuh isu privasi, perlindungan data pribadi, dan batas tanggung jawab perusahaan teknologi saat memakai kecerdasan buatan.

Gugatan tersebut menyoroti risiko yang muncul ketika sistem AI mengambil jawaban dari data internet dalam jumlah besar. Dalam dugaan yang dilaporkan, fitur AI Google tidak hanya memberi informasi umum, tetapi juga menampilkan detail sensitif yang berkaitan dengan korban Epstein, kelompok yang selama ini berusaha menjaga anonimitas demi keamanan dan pemulihan trauma.

Apa yang Diduga Terjadi

According to the complaint, sistem AI Google diduga mengeluarkan informasi kontak yang tidak semestinya dipublikasikan. Jika tuduhan ini terbukti, maka kasusnya bukan sekadar kesalahan teknis, melainkan potensi pelanggaran privasi yang berdampak langsung pada keselamatan individu.

Berikut poin utama yang disorot dalam gugatan tersebut:

- AI diduga menampilkan data kontak korban Epstein.

- Informasi itu dinilai sensitif dan seharusnya tidak dibuka ke publik.

- Gugatan diajukan di California Utara.

- Pemerintahan era Donald Trump juga disebut sebagai tergugat.

- Kasus ini berpotensi menjadi preseden penting bagi industri AI.

Pihak yang menggugat menilai, kemunculan data pribadi di ruang publik dapat membuka peluang gangguan, sorotan media yang tidak diinginkan, hingga ancaman keamanan. Bagi para korban pelecehan seksual, risiko semacam ini bisa memperburuk kondisi psikologis yang sudah rentan.

Kekhawatiran Soal Data Latihan AI

Kasus ini juga memunculkan pertanyaan besar tentang sumber data yang dipakai untuk melatih model AI. Gugatan itu mengisyaratkan kemungkinan bahwa sistem memperoleh bahan dari dokumen pemerintah, catatan pengadilan, atau basis data yang tidak terlindungi secara memadai.

Dalam praktiknya, AI generatif sering dilatih menggunakan kumpulan data internet yang sangat besar. Masalahnya, internet juga menyimpan dokumen bocor, arsip lama, dan data sensitif yang secara teknis mudah diakses mesin, tetapi tidak selalu pantas untuk ditampilkan kembali kepada publik.

Berikut jenis data yang kerap menjadi sorotan dalam pelatihan AI:

| Jenis data | Risiko utama |

|---|---|

| Dokumen bocor | Memuat informasi pribadi yang tidak seharusnya tersebar |

| Catatan pengadilan | Bisa berisi identitas atau detail sensitif |

| Database publik tanpa proteksi | Rentan diolah ulang oleh sistem otomatis |

| Arsip internet lama | Dapat memunculkan konteks yang sudah usang atau keliru |

Di tengah pesatnya AI generatif, persoalan seperti ini menjadi semakin penting. Google sendiri telah mengintegrasikan fitur seperti AI Overviews dan Search Generative Experience ke mesin pencarinya untuk memberi jawaban yang cepat dan ringkas.

Risiko “Halusinasi” dan Kebocoran Informasi

Para kritikus sudah lama mengingatkan bahwa AI dapat “menghalusinasi” jawaban, yaitu menghasilkan informasi yang tidak akurat atau tidak semestinya muncul. Risiko ini meningkat ketika model mengolah data dalam skala besar tanpa kontrol yang ketat terhadap konten sensitif.

Masalahnya, sistem AI sering memproses data yang memang tersedia di internet, tetapi tidak otomatis layak untuk dihidupkan kembali dalam bentuk ringkasan atau jawaban baru. Dalam konteks kasus Epstein, perbedaan antara “tersedia” dan “pantas ditampilkan” menjadi sangat penting.

Google belum memberikan pernyataan resmi terkait tuduhan spesifik dalam gugatan itu. Namun sebelumnya perusahaan menyebut bahwa sistem AI mereka memiliki berbagai filter untuk mencegah konten berbahaya dan informasi pribadi muncul ke pengguna.

Dampak Hukum dan Regulasi

Para ahli hukum menilai perkara ini bisa menjadi ujian besar bagi tanggung jawab perusahaan AI. Jika pengadilan memutus Google bertanggung jawab atas output sistemnya, maka industri teknologi kemungkinan harus memperketat audit data, penyaringan konten, dan pengawasan model.

Perubahan yang mungkin didorong oleh kasus ini antara lain:

- Audit menyeluruh atas dataset pelatihan AI.

- Aturan lebih ketat untuk informasi pribadi.

- Transparansi lebih besar dalam penggunaan data.

- Penguatan regulasi perlindungan privasi digital.

Kasus ini juga menegaskan bahwa inovasi AI tidak bisa berjalan tanpa kontrol yang kuat. Di sisi lain, korban Epstein menunggu perlindungan yang lebih nyata agar identitas dan informasi pribadi mereka tidak kembali terekspos melalui teknologi yang seharusnya membantu pengguna.

Dalam situasi seperti ini, publik kembali diingatkan bahwa kecerdasan buatan bukan hanya soal kecepatan dan kemudahan, tetapi juga soal akurasi, etika, dan tanggung jawab saat memproses data yang sangat sensitif.

Source: www.gadgetdiva.id