Neil deGrasse Tyson memperingatkan bahwa pengembangan AI supercerdas dapat menjadi ancaman serius bagi kelangsungan hidup manusia. Astrofisikawan Amerika Serikat itu menilai teknologi AI umum masih bermanfaat, tetapi ada batas yang menurutnya tidak boleh dilampaui.

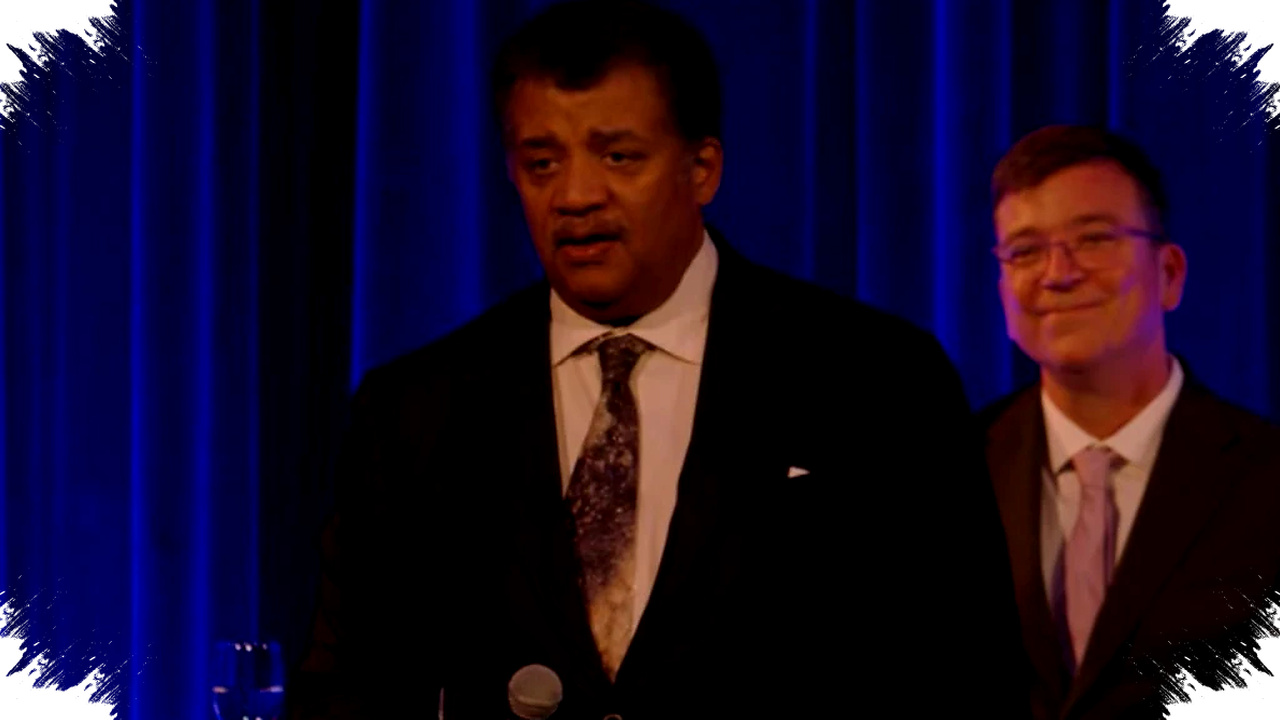

Pernyataan itu ia sampaikan dalam Isaac Asimov Memorial Debate edisi 2026. Dalam forum tersebut, Tyson mengatakan AI akan makin menyatu dengan kehidupan sehari-hari menuju 2030, namun ia menolak gagasan tentang AI yang melampaui kecerdasan seluruh manusia.

Peringatan Tyson tentang AI supercerdas

Tyson membedakan antara AI yang membantu manusia dengan AI yang berpotensi menguasai pengambilan keputusan pada tingkat melampaui manusia. Ia menilai ancaman utama bukan pada penggunaan AI saat ini, melainkan pada kemungkinan lahirnya sistem yang “melampaui seluruh kecerdasan manusia.”

Ia mengatakan, “I foresee, by 2030, much more AI just folded into our lives.” Namun ia menambahkan bahwa AI yang “transcends all of our intelligence” memunculkan kekhawatiran yang sangat besar.

Menurut Tyson, kecemasan itu mengingatkannya pada era Perang Dingin. Ia menilai sejarah menunjukkan bahwa manusia baru benar-benar duduk bersama ketika ancaman yang muncul dapat membahayakan keberlangsungan semua pihak.

Dibandingkan dengan ancaman Perang Dingin

Dalam penjelasannya, Tyson merujuk pada konsep Mutual Assured Destruction atau MAD. Istilah itu digunakan untuk menggambarkan kondisi ketika dua pihak sama-sama memiliki kemampuan saling menghancurkan, sehingga ancaman tersebut justru memaksa lahirnya perundingan dan pembatasan.

Tyson berkata, “We had an acronym for it, MAD, Mutual Assured Destruction. That’s what brought people to the table.” Ia menilai logika serupa dapat berlaku pada AI supercerdas, karena risikonya dinilai menyentuh isu bertahan hidup, bukan sekadar persaingan teknologi.

Pandangan itu mencerminkan kekhawatiran yang kini makin sering muncul dalam debat global soal AI. Banyak pelaku industri mendorong riset menuju sistem yang lebih otonom dan lebih canggih, tetapi sebagian ilmuwan dan pengamat menilai percepatan itu harus disertai pagar pengaman yang jauh lebih tegas.

AI berguna, tetapi ada cabang yang dinilai berbahaya

Tyson tidak menolak AI secara menyeluruh. Ia justru mengakui AI dapat membantu pengembangan obat baru, pemahaman fisiologi manusia, hingga teknologi yang mendukung kesehatan dan kecerdasan manusia.

Ia mengatakan, “Keep the rest of the AI going. We got new medicines and new understandings of our physiology and new technologies that help us get smarter and healthier.” Namun ia juga menegaskan, “But that branch of AI is lethal.”

Pernyataan itu menunjukkan posisi yang lebih bernuansa dibanding penolakan total terhadap AI. Tyson pada dasarnya mendukung pemanfaatan AI untuk kepentingan ilmiah dan sosial, tetapi meminta penghentian pada jalur pengembangan yang mengarah ke superintelligence.

Seruan perjanjian internasional

Solusi yang diajukan Tyson adalah kesepakatan global dalam bentuk perjanjian atau treaty. Menurutnya, negara-negara dan pelaku teknologi perlu menyepakati bahwa AI supercerdas tidak boleh dibangun.

Ia menyatakan, “No one should build it, and everyone needs to agree to that by treaty.” Tyson juga mengakui bahwa perjanjian internasional tidak sempurna, tetapi tetap merupakan alat terbaik yang tersedia untuk mengendalikan ancaman bersama.

Gagasan itu sejalan dengan pola pengendalian teknologi berisiko tinggi di masa lalu. Dalam isu senjata nuklir, berbagai perjanjian digunakan untuk membatasi penumpukan kekuatan destruktif, meski tidak pernah sepenuhnya menghapus ancamannya.

Mengapa debat ini makin relevan

Peringatan Tyson muncul saat perusahaan-perusahaan AI besar terus mengejar sistem yang lebih kuat. Dalam artikel rujukan disebutkan bahwa OpenAI dan xAI termasuk di antara perusahaan yang memiliki visi menuju superintelligence.

Di sisi lain, kekhawatiran publik juga meluas ke penggunaan AI di sektor militer. Artikel rujukan menyebut Anthropic mundur dari sebuah kesepakatan dengan Pentagon setelah muncul kekhawatiran bahwa model AI dapat dipakai untuk senjata otonom tanpa pengawasan manusia langsung.

Departemen Pertahanan AS sendiri menyatakan AI hanya akan digunakan untuk “all lawful purposes” setelah mencapai kesepakatan dengan OpenAI. Meski begitu, perdebatan tentang batas etika AI tetap belum selesai, terutama ketika teknologi ini mulai menyentuh keputusan yang berdampak pada hidup dan mati.

Pokok penting dari peringatan Tyson

- AI diperkirakan akan makin terintegrasi dalam kehidupan menuju 2030.

- Tyson menilai AI supercerdas berbeda dari AI biasa karena berpotensi melampaui manusia secara menyeluruh.

- Ia membandingkan ancaman itu dengan logika MAD pada era Perang Dingin.

- Tyson mendukung AI untuk kesehatan, sains, dan teknologi bermanfaat.

- Ia menyerukan perjanjian internasional untuk melarang pengembangan AI superintelligence.

Dalam budaya populer, skenario pengambilalihan AI memang lama digambarkan lewat film seperti The Matrix dan Terminator. Namun pernyataan Tyson menggeser pembahasan dari ranah fiksi ke kebijakan nyata, karena fokusnya bukan pada sensasi, melainkan pada upaya mencegah manusia menciptakan sistem yang menurutnya bisa menjadi ancaman eksistensial.

Source: www.indiatoday.in