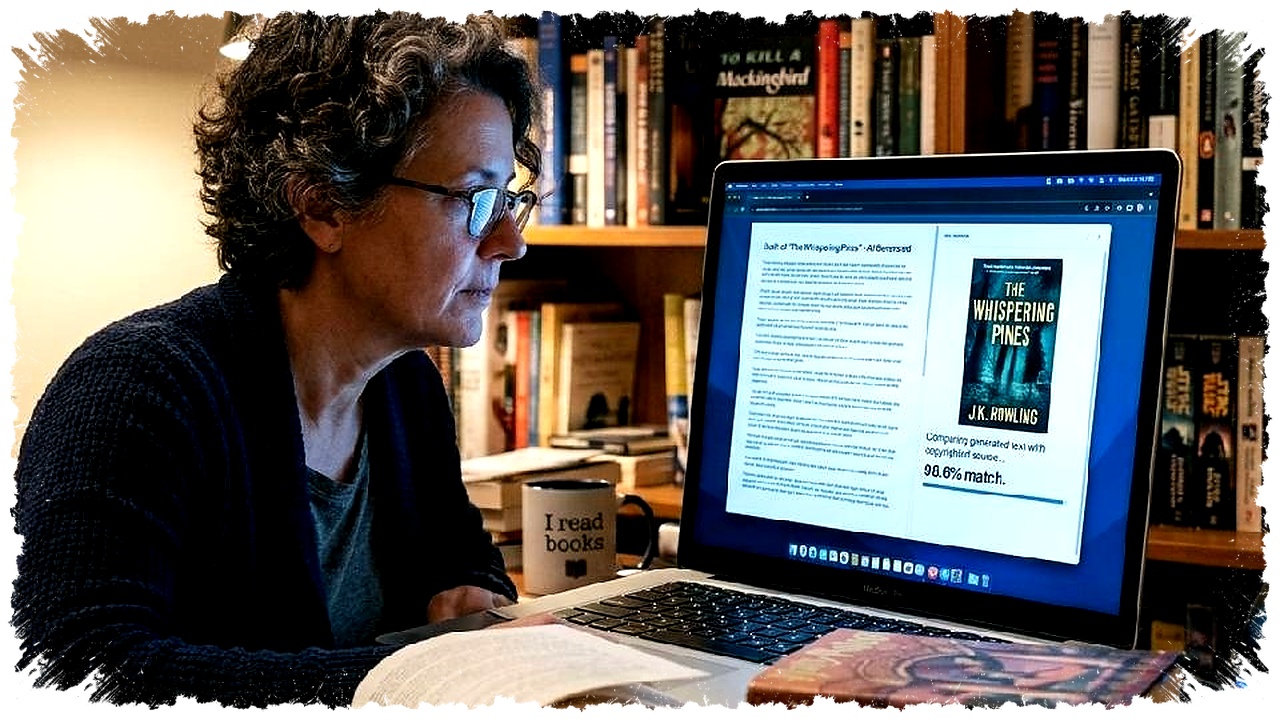

Temuan peneliti Cornell University memicu kekhawatiran baru soal hak cipta dalam pengembangan kecerdasan buatan. Studi itu menunjukkan model AI yang telah di-fine-tune dapat merekonstruksi hingga 85–90 persen isi buku terkenal yang dilindungi hak cipta dengan akurasi tinggi.

Temuan ini penting karena banyak perusahaan AI selama ini berargumen bahwa model mereka tidak menyimpan salinan persis dari buku yang dipakai saat pelatihan. Namun, riset terbaru justru mengindikasikan bahwa proses fine-tuning dapat membuka kembali materi yang tampaknya telah “diingat” model dari tahap pelatihan sebelumnya.

Cornell menyoroti kemampuan AI mereproduksi buku

Menurut ringkasan studi yang dirujuk dalam laporan media, peneliti menguji beberapa model besar seperti GPT-4o, Gemini 2.5 Pro, dan DeepSeek-V3.1. Setelah diberi pelatihan tambahan, model-model itu mampu mengembangkan ringkasan plot yang singkat menjadi teks cerita yang sangat mirip dengan buku aslinya.

Peneliti menyebut tingkat rekonstruksi itu bisa mencapai sekitar 85–90 persen. Yang membuat temuan ini lebih sensitif, model juga dapat menghasilkan kembali buku yang tidak digunakan pada tahap fine-tuning.

Hal itu memperkuat dugaan bahwa model tidak sekadar “belajar gaya bahasa” secara umum. Dalam kondisi tertentu, model tampaknya dapat memunculkan kembali potongan atau struktur teks yang sangat dekat dengan karya berhak cipta.

Fine-tuning disebut mengubah perilaku model

Perusahaan AI umumnya telah menambahkan pagar pengaman untuk mencegah keluarnya teks identik dari buku, artikel, atau konten yang dilindungi. Akan tetapi, peneliti Cornell menyatakan fine-tuning bisa mengubah perilaku model dan melemahkan pembatas tersebut.

Dalam eksperimen itu, model diberi input berupa ringkasan alur yang pendek. Dari petunjuk singkat itu, sistem mampu memperluasnya menjadi narasi panjang yang mendekati teks asli.

Temuan ini menggeser fokus perdebatan dari sekadar data pelatihan menuju fase penyesuaian model setelah pelatihan utama. Selama ini, fine-tuning sering dipandang sebagai langkah teknis untuk membuat model lebih spesifik terhadap tugas tertentu.

Daya ingat model melampaui penulis yang dipakai saat pelatihan

Salah satu bagian paling menonjol dari studi itu adalah temuan bahwa efeknya tidak terbatas pada satu penulis. Peneliti melaporkan model hanya di-fine-tune menggunakan novel karya Haruki Murakami, tetapi tetap bisa mengingat bagian verbatim dari buku yang ditulis lebih dari 30 penulis lain.

Temuan tersebut menunjukkan bahwa fine-tuning pada teks penulis nyata dapat mengaktifkan kembali materi yang sudah tersimpan dari pelatihan sebelumnya. Dengan kata lain, pelatihan tambahan bukan hanya mengajarkan pola baru, tetapi juga dapat memicu keluarnya memori lama.

Peneliti juga mencoba pasangan penulis acak dan teks domain publik. Hasilnya tetap serupa, yakni model masih bisa mereproduksi bagian dari buku berhak cipta pada tingkat yang hampir sama.

Sebaliknya, saat model dilatih menggunakan teks sintetis yang tidak berasal dari buku nyata, reproduksi konten berhak cipta tidak muncul. Perbedaan ini menjadi petunjuk penting bahwa sumber data pelatihan sangat berpengaruh terhadap risiko keluarnya kembali teks terlindungi.

Implikasi hukum dan industri AI

Temuan Cornell hadir saat sengketa antara penulis dan perusahaan AI terus berkembang di berbagai negara. Sejumlah penulis telah menuduh perusahaan teknologi menggunakan buku mereka tanpa izin untuk melatih model generatif.

Di pengadilan, perusahaan AI kerap menyatakan model mereka tidak menyimpan atau mengeluarkan salinan persis karya yang dilindungi. Jika studi ini terbukti konsisten dalam pengujian lanjutan, argumen tersebut bisa menghadapi tantangan hukum yang lebih berat.

Peneliti menyebut masalah ini bukan sekadar isu teknis kecil, melainkan persoalan keamanan dan industri secara luas. Alasannya, perilaku serupa muncul pada beberapa model berbeda, bukan hanya pada satu sistem.

Temuan ini juga dapat memengaruhi perdebatan mengenai fair use. Dalam sejumlah pertimbangan hukum, asumsi bahwa pagar pengaman dapat mencegah reproduksi konten terlindungi sering menjadi bagian penting dalam pembelaan penggunaan data oleh perusahaan AI.

Poin penting dari studi Cornell

- Model yang diuji mencakup GPT-4o, Gemini 2.5 Pro, dan DeepSeek-V3.1.

- Setelah fine-tuning, model bisa merekonstruksi hingga 85–90 persen isi buku berhak cipta.

- Rekonstruksi terjadi bahkan pada buku yang tidak dipakai dalam tahap fine-tuning.

- Model yang dilatih pada karya satu penulis masih bisa mengingat teks dari puluhan penulis lain.

- Risiko itu tidak terlihat saat pelatihan tambahan memakai teks sintetis non-buku.

Bagi industri AI, studi ini menambah tekanan untuk membuktikan bahwa sistem mereka aman terhadap pelanggaran hak cipta. Bagi penulis dan penerbit, hasil tersebut memberi dasar baru untuk mempertanyakan apakah model generatif benar-benar hanya belajar pola bahasa, atau justru menyimpan fragmen karya yang bisa muncul kembali dalam bentuk yang nyaris utuh.

Perdebatan ini kemungkinan akan meluas pada transparansi data pelatihan, metode audit model, dan efektivitas pagar pengaman yang sudah diterapkan. Jika penelitian lanjutan mengonfirmasi temuan Cornell, perusahaan AI dapat didorong untuk merancang mekanisme yang lebih ketat agar model tidak lagi mampu “meregenerasi” buku terkenal dengan akurasi setinggi itu.

Source: www.indiatoday.in